Claude Code源码分析之提示词工程

在 LLM 应用开发中,系统提示词(System Prompt)的管理往往是一个容易被忽视的工程痛点。随着应用复杂度的提升,传统的单体字符串拼接方式会导致代码难以维护,并且在面对长上下文时,容易产生不必要的高额 Token 消耗和延迟。 本文基于 Claude Code 泄露出来的源代码(主要覆盖 src/QueryEngine.ts 及 src/utils/ 等核心模块),从工程视角拆解其提示词管理的系统架构。其核心设计理念包括:极致的模块化解耦、对 Prompt Caching(提示词缓存)的深度优化、多级路由调度机制以及并发的上下文组装。 1. 提示词的模块化注册机制对于复杂应用,单体字符串形式的 Prompt 极易引发代码冲突与逻辑混乱。Claude Code 在这方面采用了类似中间件的模块化注册机制。这种设计使得新增能力(如引入特定的 MCP Server 指令)时,只需在组装层增加相应的 Section,无需在数千行的主字符串中修改,符合软件设计的开闭原则(OCP)。 在 src/constants/systemPromptSections.ts 中,各类规则和指令被抽象为 ...

机器学习平台技术栈之Volcano:概念、架构与关键技术深度剖析

随着大模型和人工智能技术的爆发,底层的算力基础设施迎来了前所未有的挑战。传统的 Kubernetes 调度器最初为微服务(长运行的无状态或有状态服务)设计,在面对机器学习训练、大数据分析等 高性能计算(HPC) 和 批处理(Batch Processing) 任务时,显得捉襟见肘。 为了解决云原生环境下机器学习平台对高级调度的需求,CNCF 首个批量计算项目 Volcano 应运而生。本文将深度解析 Volcano 的核心概念、架构设计、关键技术细节,以及它在机器学习平台中扮演的底层基石角色。 摘要在云原生 AI 基础设施中,调度系统的能力直接决定了算力集群的利用率和分布式训练的效率。本文从 Kubernetes 原生调度器的痛点出发,系统性地阐述 Volcano 的核心对象及其相互关系,深度拆解其架构模块,并详细剖析了 Gang Scheduling(组调度)、Fair-share(公平调度)、资源队列与多租户机制、拓扑感知等关键技术细节,最后探讨其在真实机器学习平台生态(如 Kubeflow、Ray 结合)中的最佳实践。 一、 引言:为什么机器学习平台需要 Volcano? ...

Claude Code源码分析之架构设计

Claude Code是一款强大的基于终端运行的 AI 编程助手工具,其背后的工程实现远非简单的“脚本调用大模型 API”,而是一套高度抽象、解耦且具备极佳扩展性的现代软件架构。通过深度拆解其意外流出的源码结构,我们可以清晰地看到以大语言模型 (LLM) 为计算核心的 CLI 应用是如何处理复杂交互、状态机流转、本地运行时安全保障及外部生态扩展的。 本文将从技术栈选型、终端前端渲染、核心逻辑引擎、工具链协议、状态管理体系以及扩展通信桥接等多个维度,对该项目的架构设计进行详细的源码级分析。 代码仓库: https://github.com/sanmuny/claude-code-source-code 核心架构示意图在深入探讨代码之前,我们可以先通过系统的模块交互全景视图建立直观的认知: 1. 核心架构与技术栈概览通读 package.json 及核心代码目录,该项目使用了极度现代化的底层技术栈。这些技术的选取体现了作者在启动性能与开发效率之间极佳的平衡考量: 核心语言与运行时基座:系统主体通过 TypeScript 严格类型约束编写,并在部分执行环节强依赖于 Bun 的运行时特 ...

告别提示词硬编码!这款开源的提示词管理神器,正在重塑智能体的开发流

深夜 11 点,微信群弹出一条消息。 产品经理:“小王,那个 AI 客服的语气能不能再温柔一点?顺便把双十一的最新活动规则加进去,明早要上服。” 你默默看着代码库里那段长达 100 多行的 System Prompt,叹了口气。改完这句话,你又要经历:本地构建 -> 提交代码 -> 等待 CI/CD 流水线 -> 灰度发布…… 仅仅因为改了几个字,整个系统就要被重新折腾一遍。 在全面拥抱 AI、快速构建大语言模型(LLM)应用与智能体(Agent)的今天,你是否也在忍受这些“反人类”的痛点: 💥 极高的调试成本:Prompt 深度耦合在业务代码里,每一次 Prompt 的字眼微调,都伴随着沉重的重新编译与发版过程。 🧱 跨部门协作的“隔离墙”:懂业务的运营人员和懂提示词工程的 Prompt 专家无法直接修改指令,必须沦为“提需求的人”,苦苦排期等待研发实现。 🌀 失控的多智能体灾难:在 Multi-Agent 架构下,成百上千个不同角色的性格设定、工具约束像牛皮癣一样散落在代码的各个角落,版本回溯更是天方夜谭。 如果这些场景让你感到窒息,那么你正面临 L ...

【论文解读】Agentic Reasoning for Large Language Models

大家好,今天分享一篇 2026 年初非常值得精读的综述论文:《Agentic Reasoning for Large Language Models》,由伊利诺伊大学厄巴纳-香槟分校、Meta、亚马逊、Google DeepMind、UCSD和耶鲁大学等多机构联合发布。不同于普通的技术论文,这篇综述系统梳理了大语言模型(LLM)从“文本生成工具”向“自主智能体(Autonomous Agents)”跃迁的核心范式、推理机制,以及当前行业的技术现状与未来方向,是入门和深耕 Agent 领域的必备参考。 论文链接:https://arxiv.org/abs/2601.12538 一、为什么需要 Agentic Reasoning?(核心背景与价值)要理解 Agentic Reasoning(智能体推理)的必要性,首先要明确传统大模型的局限性,以及真实世界任务的核心需求,这也是论文开篇重点阐述的内容。 1. 传统大模型的“能力边界”传统 LLM(如 GPT-4、Llama 3 等)在静态、封闭上下文(Closed-world Settings)中已经展现出极强的生成与推理能力——比如做数 ...

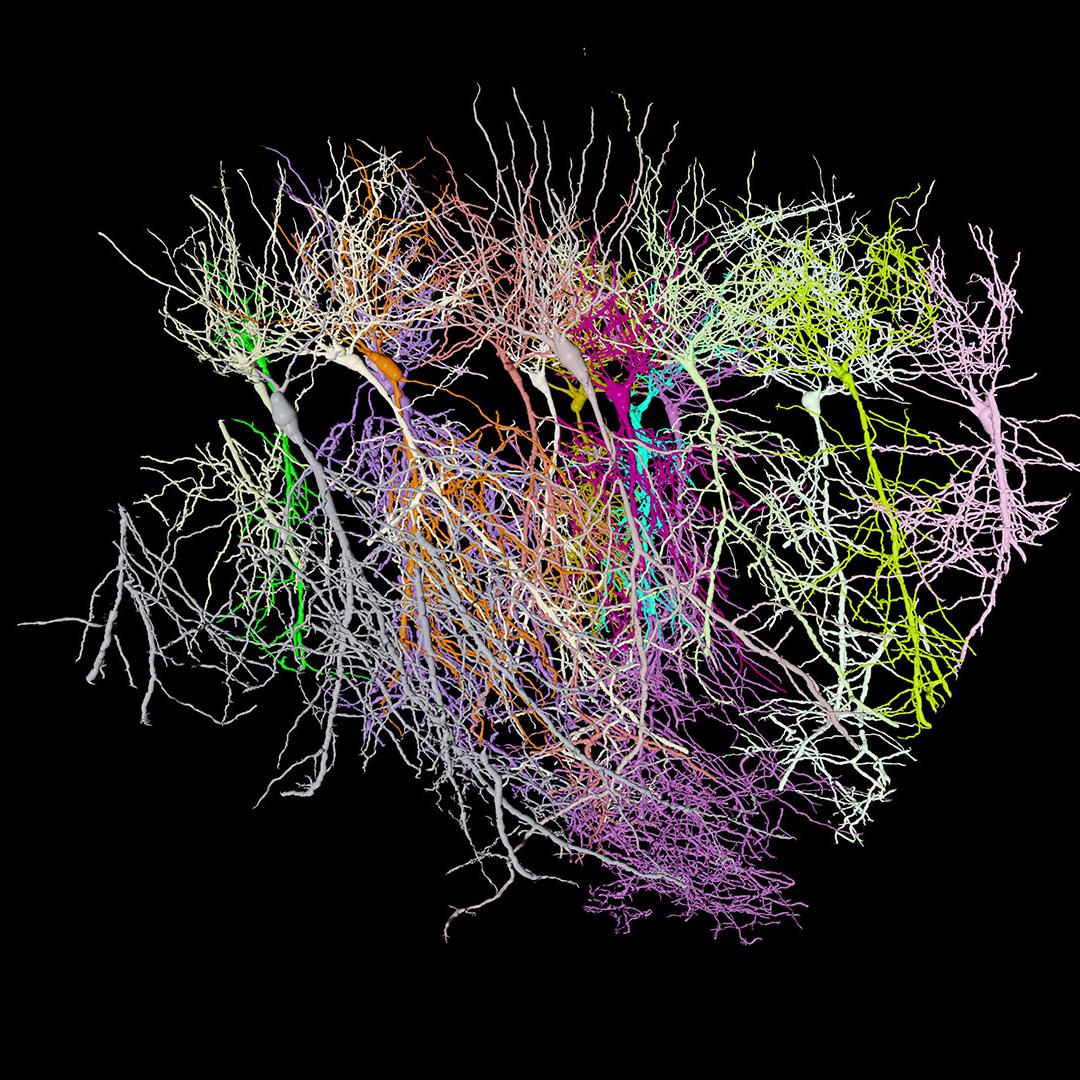

CNN卷积神经网络学习笔记

在人工智能图像识别领域,卷积神经网络(Convolutional Neural Network, CNN)扮演着核心角色。无论是移动设备的场景识别、医学影像的病灶检测,还是身份验证中的人脸识别,其底层核心技术均离不开CNN。与传统神经网络相比,CNN能够高效提取图像的空间特征,有效解决了图像像素维度高、模型参数易爆炸的技术痛点。 本文将从基础原理出发,系统拆解CNN的核心机制与关键技术术语,结合完整的PyTorch代码实例(花卉分类任务),清晰阐述CNN的工作流程,以及基于PyTorch框架实现简易CNN模型的具体步骤,为零基础学习者提供可落地的技术参考。 一、CNN核心入门:关键问题解析1. 传统神经网络在图像识别中的局限性以本文后续实现的CNN花卉分类模型中采用的花卉图像为例,其尺寸为150×150×3(宽度150、高度150、3个RGB颜色通道),总计包含150×150×3=67500个像素点。若采用传统全连接神经网络,其输入层神经元数量需与像素点数量保持一致,即67500个输入神经元。 假设第一层隐藏层设置1000个神经元,该层的参数总量将达到67500×1000=67,500 ...

OCI 镜像规范详解

在容器技术发展的早期,Docker 镜像是事实上的标准。随着容器生态的爆发,为了确保不同容器运行时(如 Docker, containerd, CRI-O, Podman 等)和构建工具之间的互操作性,Open Container Initiative (OCI) 成立并推出了 OCI Image Specification。 本文将基于最新的 OCI Image Specification 详细解读 OCI 镜像的构成及其背后的技术细节。 OCI 镜像规范概览OCI 镜像规范定义了 OCI 镜像的结构。简单来说,一个 OCI 镜像包含以下几个核心部分: Image Manifest (镜像清单): 描述构成镜像的组件(包括配置和层)。 Image Index (镜像索引): (可选) 指向多个 Manifest 的列表,通常用于支持多架构(如 amd64, arm64)。 Image Layout (镜像布局): 镜像在文件系统上的目录结构。 Filesystem Layer (文件系统层): 包含了容器文件系统的更改集 (Changeset)。 Image Config ...

挑战5天和AI一起从零上线一个全栈Web应用

AI编程助手(如GitHub Copilot)已经成为开发者日常不可或缺的工具,但它究竟能做到什么程度?是只能写写简单的函数,还是能真正作为一个“能够独立交付项目的同事”? 抱着这个疑问,我给自己设定了一个挑战:利用业余时间,在5天内,和一个AI编程助手结对,从零开始开发并上线一个完整的Web应用MVP(最小可行性产品)。 与之相关的核心原则是:拒绝“False Hope”的氛围编程(Vibe Coding)。不仅仅是让AI生成代码然后跑起来,而是要求生成的代码必须经过Review,必须有完善的单元测试(UT)和功能验证测试(FVT),必须符合工业级的代码规范与架构设计。我要保持对每一行代码的掌控力。 项目概览:Awsome Prompt人员配置: 我的技术栈:Linux、云计算、AI Infra、Web全栈、Devops 编程助手:Github copilot 大语言模型:Gemini 3 Skill: /ui-ux-pro-max 产品定义: 实现一个提示词管理工具,用户可以创建和管理提示词模板,提示词模板中的$$表示占位符。 在提示词模板详情页里,用户可以输入真实的变量内容 ...

Aibrix是如何利用Envoy进行LLM API流量转发的?

在大模型(LLM)推理服务中,如何高效地进行流量调度是一个核心挑战。不同于传统的微服务,LLM请求具有长耗时、高并发、对GPU显存敏感等特点。Aibrix 作为一款专为 GenAI 设计的云原生基础设施,巧妙地结合了 Envoy Proxy 的强大流量治理能力,实现了一套智能的 LLM 流量转发机制。 本文将深入探讨 Aibrix 是如何利用 Envoy 及 Envoy Gateway 构建其流量转发层的。 Envoy 基础Envoy ProxyEnvoy Proxy 是一个开源的高性能边缘和服务代理,最初由 Lyft 开发。它专为云原生应用设计,已成为现代服务网格(Service Mesh)和 API 网关的事实标准。通俗来讲,它就是一个类似于Nginx的反向代理服务器,只不过支持更加贴合Kubernetes的配置,成为云原生时代的宠儿。 在 v1.36.2 版本中,Envoy 继续巩固了其作为“通用数据平面”的地位。对于 LLM 场景,Envoy 的以下特性尤为关键: 动态配置更新:利用xDS协议,支持动态配置更新(利用文件系统inotify机制或配置服务器) 高性能:基于 C+ ...

利用GitLab Runner缓存与制品功能优化CI/CD流水线

在项目中,我们使用 Go 语言开发核心功能,同时使用 Python 编写功能验证测试(FVT)。随着代码库的增长,CI/CD 流水线的执行时间逐渐变长,特别是在依赖安装和代码检查阶段。为了提升开发效率,我们最近对 GitLab CI 配置进行了优化。 优化方案1. 依赖缓存策略通过 GitLab Runner 的缓存机制,我们为不同语言的依赖项设置了独立的缓存: 1234567891011121314151617181920212223variables: GIT_CLONE_PATH: "${CI_BUILDS_DIR}/${CI_PROJECT_NAME}-build-${CI_JOB_ID}-${CI_PIPELINE_ID}" PIP_CACHE_DIR: "${CI_PROJECT_DIR}/.cache/pip" GOLANGCI_LINT_CACHE: "${CI_PROJECT_DIR}/.cac ...